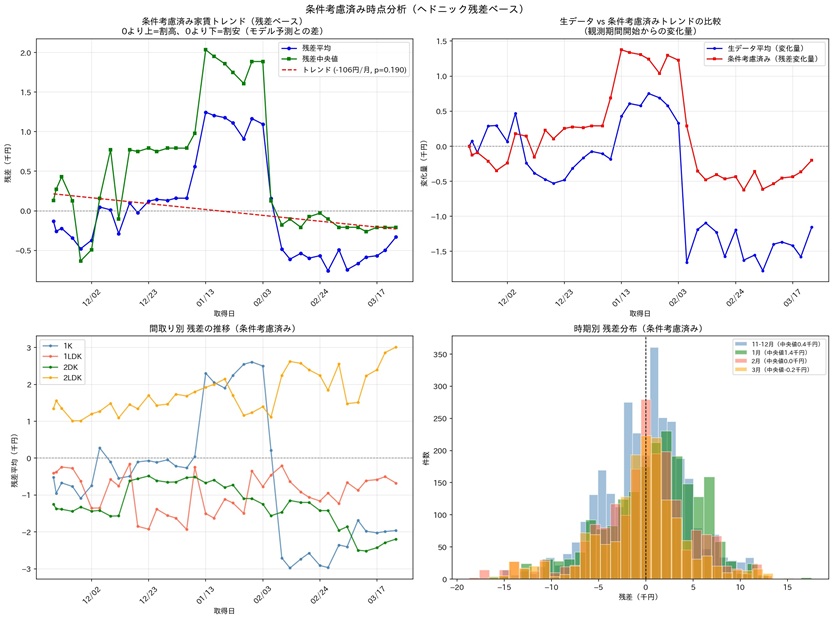

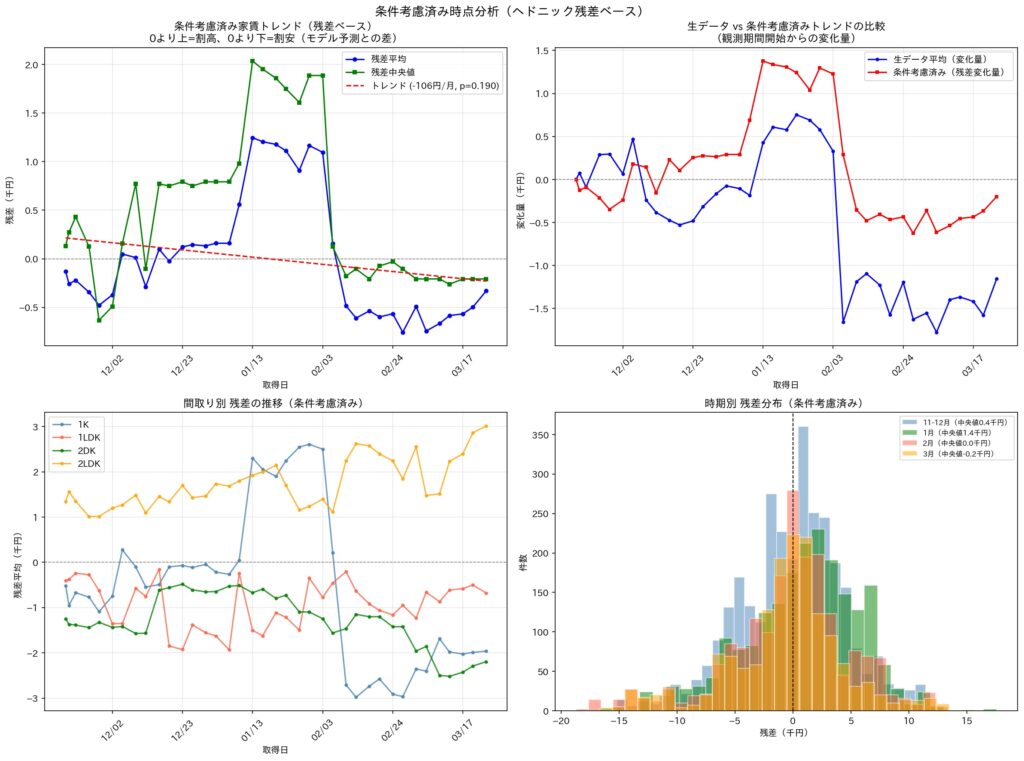

ついにAEがとられた、コンクリート悲鳴を。それは4月3日だったようだ。EEPROMのデータ保存の限界をも超える回数がこの日に集中して発生した。

そのデータは次の通り

[ EEPROM Data Analysis Report ]

Type | Date Time (UTC/Local) | Millis (raw) | Details

--------------------------------------------------------------------------------

SYNC | 2026-01-14 13:25:51 | 325120 | Time Synchronized (Unix:1768364751)

DATA | 2026-01-14 14:25:45 | 3919360 | CH0:0, CH1:19, CH2:0, CH3:0

DATA | 2026-01-15 06:45:30 | 62704128 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-01-16 00:26:07 | 126341632 | CH0:0, CH1:8, CH2:0, CH3:1

DATA | 2026-01-16 06:11:56 | 147090432 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-16 07:11:10 | 150644736 | CH0:0, CH1:0, CH2:3, CH3:7

DATA | 2026-01-16 10:10:08 | 161382912 | CH0:0, CH1:16, CH2:0, CH3:0

DATA | 2026-01-16 10:16:08 | 161742848 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-01-16 10:57:17 | 164211968 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-16 12:33:41 | 169995520 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-16 12:47:02 | 170796544 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-01-17 16:21:30 | 270064640 | CH0:0, CH1:11, CH2:1, CH3:1

DATA | 2026-01-18 01:01:31 | 301265664 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-18 05:01:11 | 315645696 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-18 12:22:00 | 342094336 | CH0:0, CH1:1, CH2:6, CH3:6

DATA | 2026-01-19 00:38:54 | 386308608 | CH0:0, CH1:45, CH2:0, CH3:0

DATA | 2026-01-19 06:01:51 | 405686016 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-01-20 12:54:55 | 516869376 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-01-20 18:41:19 | 537653504 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-01-22 01:14:26 | 647640576 | CH0:0, CH1:7, CH2:0, CH3:3

DATA | 2026-01-25 12:50:54 | 948628992 | CH0:0, CH1:9, CH2:0, CH3:2

DATA | 2026-01-29 15:48:20 | 1304874752 | CH0:0, CH1:23, CH2:3, CH3:4

RSET | 2026-01-30 12:55:41 | 0 | System Boot / Reset Detected

SYNC | 2026-01-30 12:58:24 | 162304 | Time Synchronized (Unix:1769745504)

DATA | 2026-02-02 07:11:04 | 238522368 | CH0:0, CH1:18, CH2:0, CH3:0

DATA | 2026-02-11 03:04:13 | 1001311744 | CH0:0, CH1:14, CH2:0, CH3:0

DATA | 2026-02-11 03:05:17 | 1001375488 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-02-11 03:05:32 | 1001391104 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-02-11 03:05:38 | 1001396992 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-02-11 20:56:11 | 1065629696 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-02-12 02:20:55 | 1085114112 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-02-13 04:52:31 | 1180610048 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-02-13 16:06:15 | 1221033472 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-02-14 04:36:21 | 1266039552 | CH0:0, CH1:21, CH2:0, CH3:0

DATA | 2026-02-14 11:25:23 | 1290581760 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-02-15 19:41:56 | 1406774528 | CH0:0, CH1:10, CH2:0, CH3:0

DATA | 2026-02-16 06:46:56 | 1446674432 | CH0:0, CH1:17, CH2:0, CH3:0

DATA | 2026-02-19 01:26:57 | 1686675712 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-02-19 07:30:40 | 1708499200 | CH0:0, CH1:9, CH2:1, CH3:3

DATA | 2026-02-22 23:06:21 | 2023840000 | CH0:0, CH1:8, CH2:2, CH3:3

DATA | 2026-02-25 02:14:54 | 2207952384 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-02-25 15:19:46 | 2255044352 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-02-25 15:19:47 | 2255045376 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-02-25 15:20:12 | 2255070976 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-02-25 15:20:28 | 2255087104 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-02-25 16:04:21 | 2257719552 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-02-27 15:27:14 | 2428293120 | CH0:0, CH1:6, CH2:1, CH3:2

DATA | 2026-02-28 09:24:28 | 2492926464 | CH0:0, CH1:7, CH2:1, CH3:2

DATA | 2026-02-28 15:22:11 | 2514389504 | CH0:0, CH1:47, CH2:0, CH3:0

RSET | 2026-02-28 15:22:16 | 0 | System Boot / Reset Detected

SYNC | 2026-02-28 15:23:41 | 84736 | Time Synchronized (Unix:1772259821)

DATA | 2026-02-28 16:22:11 | 3595008 | CH0:0, CH1:9, CH2:0, CH3:6

DATA | 2026-02-28 20:06:00 | 17023744 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-02 06:44:43 | 141747712 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-03-02 19:21:35 | 187159296 | CH0:0, CH1:6, CH2:0, CH3:1

DATA | 2026-03-02 20:19:02 | 190606592 | CH0:0, CH1:7, CH2:1, CH3:0

DATA | 2026-03-05 00:55:43 | 380007680 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-05 21:33:28 | 454272512 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-07 14:02:37 | 600020736 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-03-09 19:00:06 | 790670336 | CH0:0, CH1:7, CH2:3, CH3:4

DATA | 2026-03-10 00:18:46 | 809790464 | CH0:0, CH1:6, CH2:0, CH3:3

DATA | 2026-03-10 16:39:23 | 868627456 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-03-13 05:32:21 | 1087804928 | CH0:0, CH1:10, CH2:0, CH3:0

DATA | 2026-03-14 16:40:40 | 1214304256 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-03-15 16:23:37 | 1299681536 | CH0:0, CH1:2, CH2:0, CH3:6

DATA | 2026-03-16 10:20:39 | 1364303616 | CH0:0, CH1:7, CH2:1, CH3:4

DATA | 2026-03-19 06:51:25 | 1610949376 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-19 07:55:09 | 1614773248 | CH0:0, CH1:7, CH2:0, CH3:4

DATA | 2026-03-19 12:41:35 | 1631958784 | CH0:0, CH1:6, CH2:0, CH3:3

DATA | 2026-03-20 12:22:36 | 1717220608 | CH0:0, CH1:7, CH2:0, CH3:4

DATA | 2026-03-21 03:03:15 | 1770059008 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-23 20:37:49 | 2006133504 | CH0:0, CH1:8, CH2:1, CH3:3

DATA | 2026-03-23 22:03:58 | 2011301888 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-03-24 20:07:34 | 2090718720 | CH0:0, CH1:9, CH2:1, CH3:0

DATA | 2026-03-26 08:34:18 | 2221922048 | CH0:0, CH1:8, CH2:2, CH3:1

DATA | 2026-03-30 20:22:17 | 2610001408 | CH0:0, CH1:6, CH2:0, CH3:1

DATA | 2026-03-30 23:32:58 | 2621442048 | CH0:0, CH1:9, CH2:0, CH3:1

DATA | 2026-04-01 01:21:57 | 2714381312 | CH0:0, CH1:7, CH2:3, CH3:3

DATA | 2026-04-01 12:32:47 | 2754631680 | CH0:0, CH1:8, CH2:3, CH3:4

DATA | 2026-04-02 04:41:27 | 2812751360 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-02 18:58:32 | 2864176384 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 09:12:40 | 2915424512 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 09:12:42 | 2915425792 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-04-03 09:12:45 | 2915429632 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 09:12:54 | 2915438080 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:11:21 | 2940544768 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:11:22 | 2940546304 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:11:27 | 2940551168 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-04-03 16:11:33 | 2940557568 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:11:36 | 2940560128 | CH0:0, CH1:15, CH2:0, CH3:0

DATA | 2026-04-03 16:11:42 | 2940565760 | CH0:0, CH1:10, CH2:0, CH3:0

DATA | 2026-04-03 16:11:55 | 2940579072 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-04-03 16:11:57 | 2940581120 | CH0:0, CH1:14, CH2:0, CH3:0

DATA | 2026-04-03 16:11:59 | 2940582912 | CH0:0, CH1:12, CH2:0, CH3:0

DATA | 2026-04-03 16:12:47 | 2940631552 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:12:50 | 2940634368 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-04-03 16:13:14 | 2940658176 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-04-03 16:13:24 | 2940667904 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:13:25 | 2940669696 | CH0:0, CH1:13, CH2:0, CH3:0

DATA | 2026-04-03 16:13:37 | 2940681216 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-04-03 16:13:52 | 2940696576 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-04-03 16:14:02 | 2940705792 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:15:42 | 2940806656 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-04-03 16:15:50 | 2940814592 | CH0:0, CH1:12, CH2:0, CH3:0

DATA | 2026-04-03 16:16:25 | 2940849152 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:16:29 | 2940852736 | CH0:0, CH1:14, CH2:0, CH3:0

DATA | 2026-04-03 16:16:57 | 2940881408 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:17:22 | 2940906496 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:17:24 | 2940908032 | CH0:0, CH1:8, CH2:0, CH3:0

DATA | 2026-04-03 16:17:24 | 2940908544 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:17:33 | 2940917504 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:17:53 | 2940937728 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:18:26 | 2940970496 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-04-03 16:18:58 | 2941002496 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:18:59 | 2941003008 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:19:41 | 2941044736 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:19:47 | 2941050880 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:20:06 | 2941069824 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:20:07 | 2941070848 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-04-03 16:20:41 | 2941104896 | CH0:0, CH1:9, CH2:0, CH3:0

DATA | 2026-04-03 16:20:49 | 2941113088 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:20:56 | 2941120512 | CH0:0, CH1:7, CH2:0, CH3:0

DATA | 2026-04-03 16:21:01 | 2941125376 | CH0:0, CH1:11, CH2:0, CH3:0

DATA | 2026-04-03 16:21:05 | 2941129216 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:21:26 | 2941149952 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:21:30 | 2941154304 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:21:35 | 2941159168 | CH0:0, CH1:6, CH2:0, CH3:0

DATA | 2026-04-03 16:22:02 | 2941186560 | CH0:0, CH1:6, CH2:0, CH3:0

-----------------------------------------------------------------------

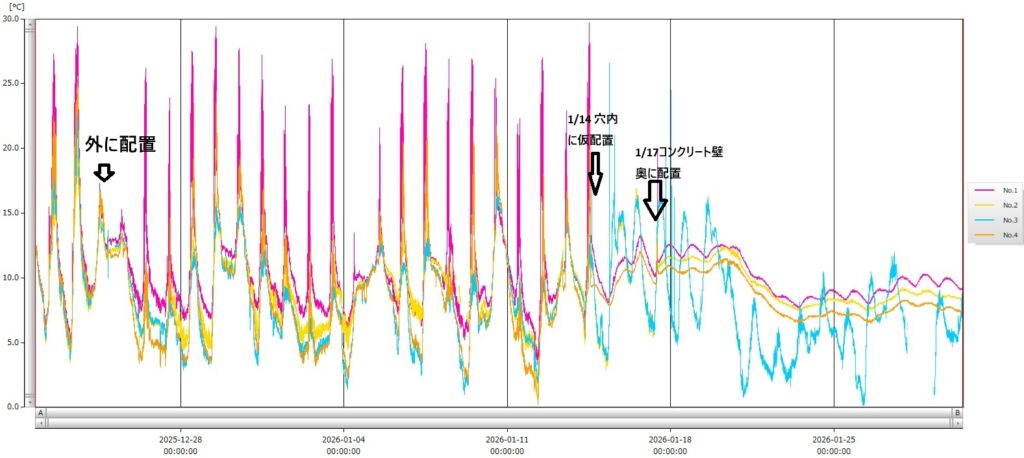

このように、4月2日以前は、ほとんどそのようなことがなかったが、4月3日に異常なAEの発生が頻発している。最初は4月3日のAM9:00ころから、ここで何があったのか気象情報を確認した。これまでの画像データ解析で気になった、雨が関連するのかを確認したが、この時間帯は、晴れで、雨も降っていないし、風も2m/s程度でそれほど吹いていなかった。

気象データをよく見ると、4月3日のAM9:00前後で天候が大きく変わっていることを確認した。 湿度90%⇒40%、気温8℃⇒18℃と一気に変化していたのである。また、それほど発生数が多くはないがAEが集中した1月16日、2月25日も雨⇒晴れという似たような気象変化が起こっていた。

そこで、これが原因ではないかと言うことで、仮説と事例や関連情報を確認した。いかは、その結果をGEMINIが、まとめたものである。

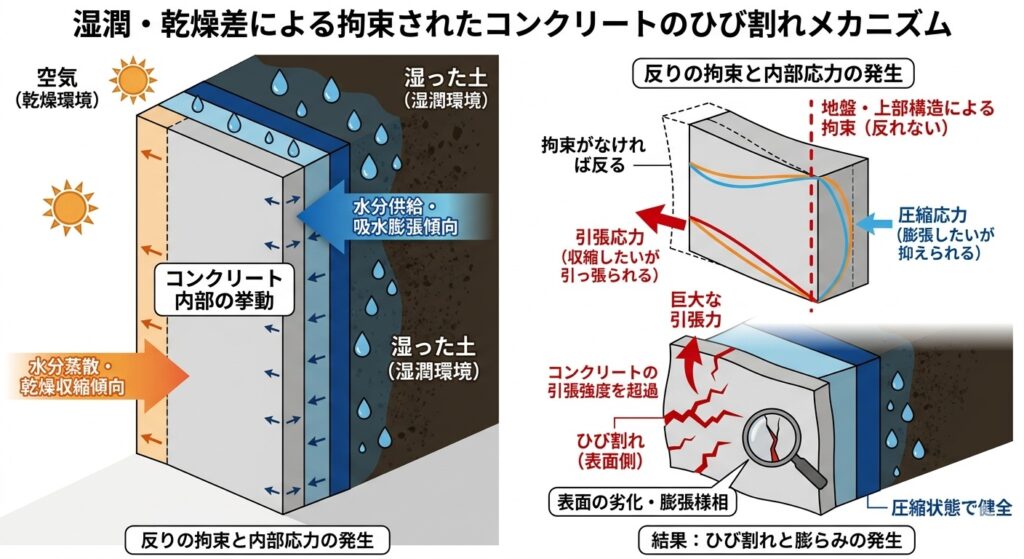

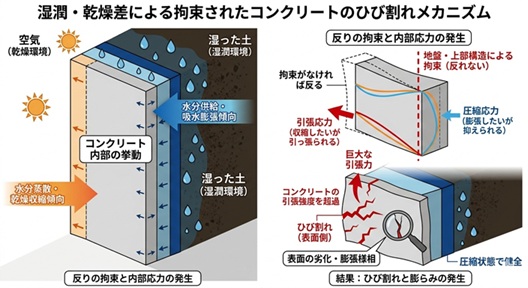

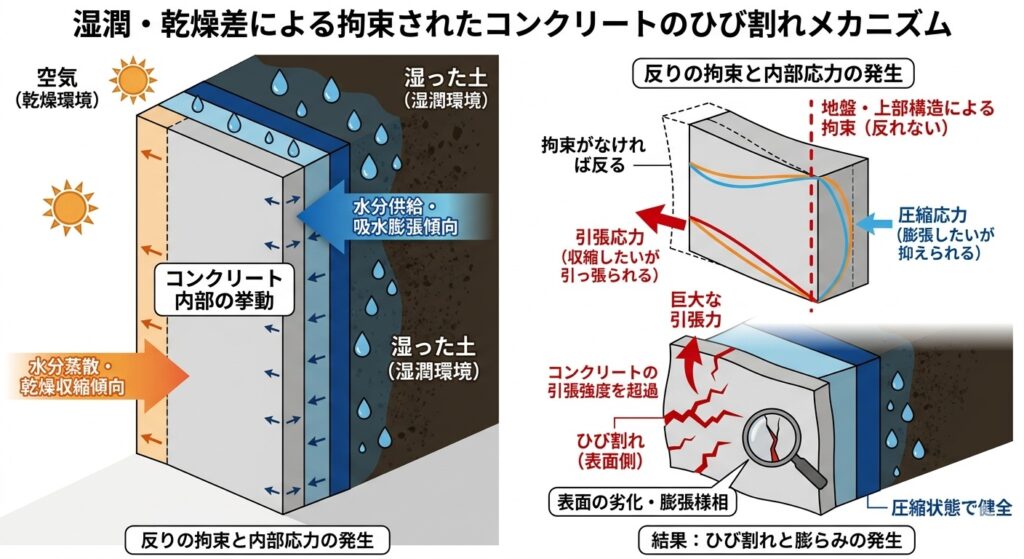

コンクリートが「膨らんで」割れる?湿度差が生む『反りの拘束』とひび割れのメカニズムを徹底解説

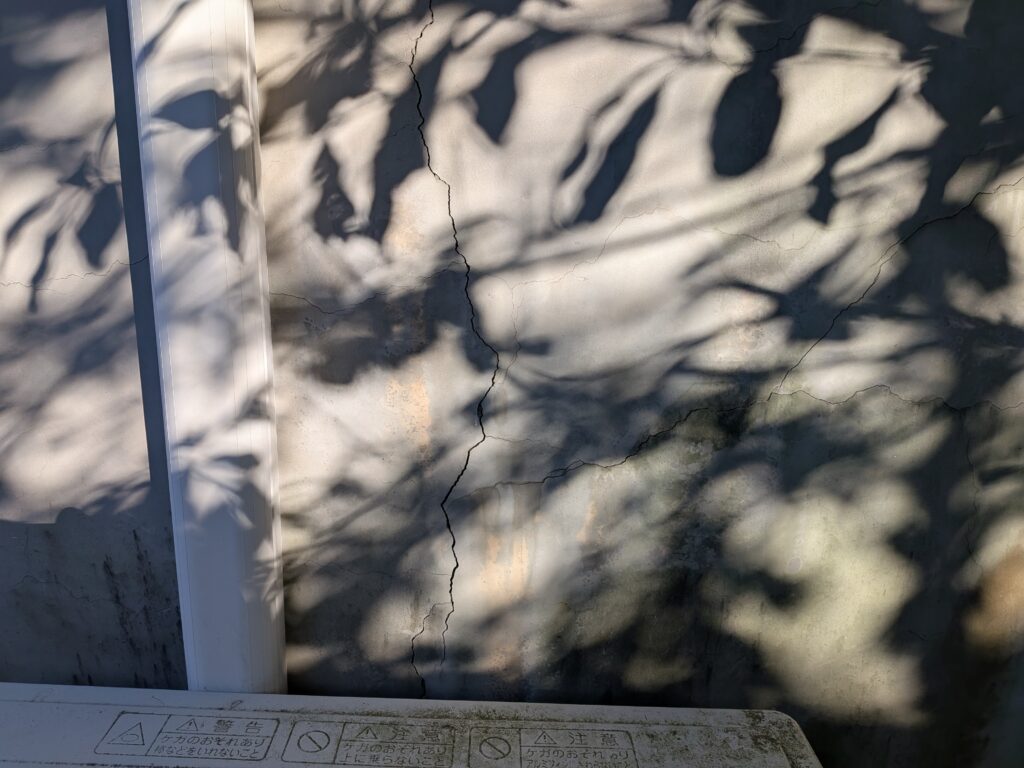

コンクリート構造物の表面に、身に覚えのないひび割れや、わずかな「膨らみ」を見つけたことはありませんか?一般的にコンクリートは「乾燥して縮む(乾燥収縮)」ことで割れると思われがちですが、実はその裏側にある「湿度の不均衡」が真の原因であるケースが少なくありません。 特に、片面が土に接し、もう片面が外気にさらされているような環境では、コンクリート内部で巨大なエネルギーが衝突しています。本記事では、専門家も注目する「反りの拘束」によるひび割れメカニズムを、図解とともに分かりやすく解説します。

1. コンクリートは「生き物」のように動いている?

1-1. コンクリートの体積変化を引き起こす4つの要因

コンクリートは一度固まれば岩のように変化しないと思われがちですが、実は環境の変化に応じて常に微細な伸縮を繰り返しています。

- 温度変化: 熱くなれば膨らみ、冷えれば縮みます。

- 湿度変化: 水分を吸えばわずかに膨張し、乾けば収縮します。

- 化学反応: 内部の成分が反応して異常膨張を起こすことがあります(アルカリ骨材反応など)。

- 外力: 土圧や上部構造の重みによる物理的な圧力。

1-2. なぜ「湿度」が重要なのか

コンクリートの内部には、目に見えないほど微細な「空隙(くうげき)」が無数に存在します。この隙間に含まれる水分の量(含水率)が変わることで、コンクリート組織を構成する粒子間の距離が変化し、それが全体の「体積変化」として現れるのです。

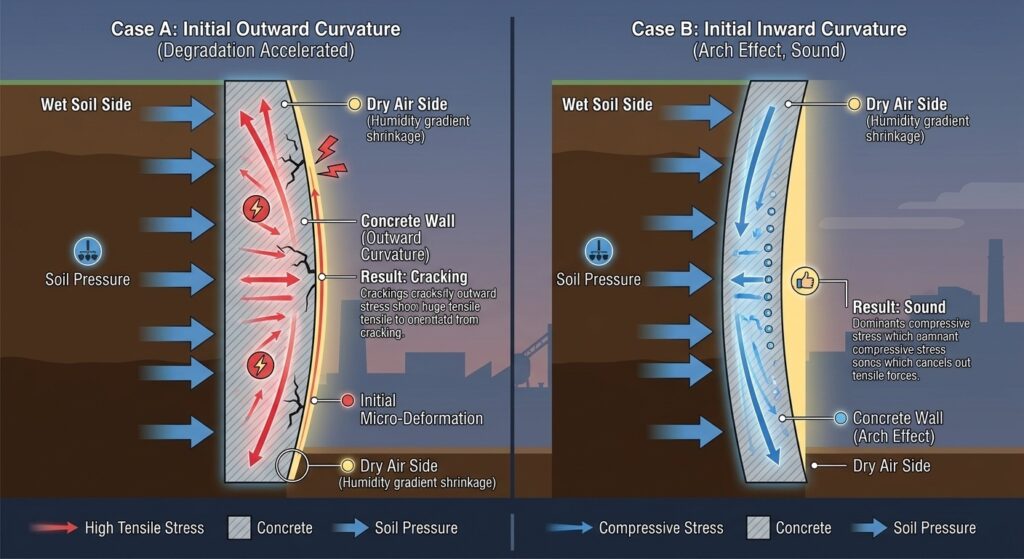

2. 片面が土、片面が空気――この「不均衡」が引き金になる

2-1. 裏面(土側)で起きている「吸水膨張」

地下室の壁や擁壁、ベタ基礎など、片面が常に湿った土に接している場合、その面は常に水分を供給され続けます。これにより、コンクリートの裏側は「膨張」しようとする、あるいは少なくとも「収縮しない」状態が維持されます。

2-2. 表面(空気側)で起きている「乾燥収縮」

一方で、太陽光や風にさらされている表面は、水分がどんどん蒸散していきます。すると、表面だけが「縮もう」とする力が働きます。

2-3. 「反り(ワーピング)」現象の発生

この「裏面は膨らみたい」「表面は縮みたい」という力の差が生じると、コンクリート板は自然と湿っている側を凸(外側へ膨らむ形)に、乾いている側を凹に曲がろうとします。これを専門用語で「反り(ワーピング)」と呼びます。

コンクリート劣化のメカニズム

コンクリート劣化のメカニズム

3. 【核心】「反れない」からこそ、コンクリートは悲鳴を上げる

3-1. 拘束状態がもたらす内部応力

もしコンクリートが空中に浮いていれば、単に「反る」だけで済みます。しかし、現実の構造物はそうはいきません。

- 土の重みによる押さえつけ

- 隣接する壁や柱との接続

- 地面との摩擦

これらによって「反り」が抑え込まれることを「拘束」と呼びます。反りたいのに反れないとき、コンクリート内部には凄まじい**「内部応力」**が発生します。

3-2. 引張強度の限界とひび割れ

コンクリートは「押される力」には非常に強いですが、「引っ張られる力」には驚くほど脆い(圧縮強度の約1/10)という弱点があります。 反りを抑え込まれた結果、乾燥している表面側には「無理やり引き延ばされる力(引張応力)」が集中します。この力がコンクリートの限界を超えた瞬間、バリバリとひび割れが発生するのです。

4. なぜ「膨らんでいる」ように見えるのか?

読者の皆さんの中には、「ひび割れた部分が少し浮き上がって(膨らんで)見える」と感じる方もいるでしょう。これには明確な理由があります。

- マイクロクラックの集合: 表面に無数の微細なひびが入ることで、組織がスカスカになり、見た目の体積が増えたように感じられます。

- 裏面からの押し出し: 反りを抑え込んでいるとはいえ、裏面の膨張圧は消えていません。弱くなった表面のひび割れ部分を、裏面が押し出すような形になり、局所的な膨らみとして観察されます。

- 鉄筋の錆(さび): ひび割れから水や酸素が入り込むと、中の鉄筋が錆びます。鉄筋は錆びると体積が2.5倍以上に膨らむため、これが内側からコンクリートを押し出し、「爆裂」と呼ばれる大きな膨らみと欠落を引き起こします。

5. 被害を最小限に食い止めるための対策と管理

5-1. 設計・施工段階での対策

- 伸縮継手の適切な配置: 力を逃がす「逃げ道」を作っておく。

- 湿潤養生の徹底: 急激な乾燥を防ぎ、初期の強度を十分に確保する。

- 防水・透湿コントロール: 土に接する面の防水処理や、表面の乾燥を抑えるコーティング。

5-2. 構造物ヘルスモニタリングの重要性

目視でひび割れが見つかった時には、すでに内部で深刻な劣化が進んでいることもあります。 最新の「構造物ヘルスモニタリング」では、センサーを用いて以下の項目をリアルタイムで監視します。

- 温湿度センサー: 表面と裏面の不均衡を早期に検知。

- 歪みゲージ: 拘束によって生じている「目に見えないストレス」を計測。

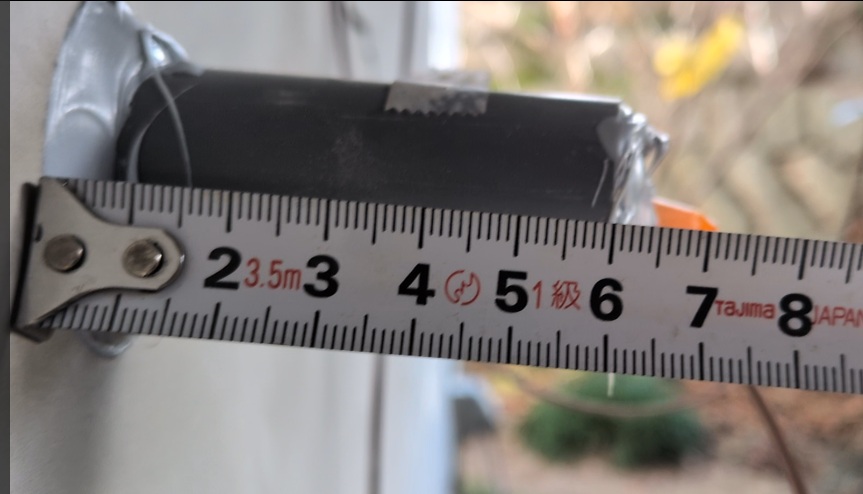

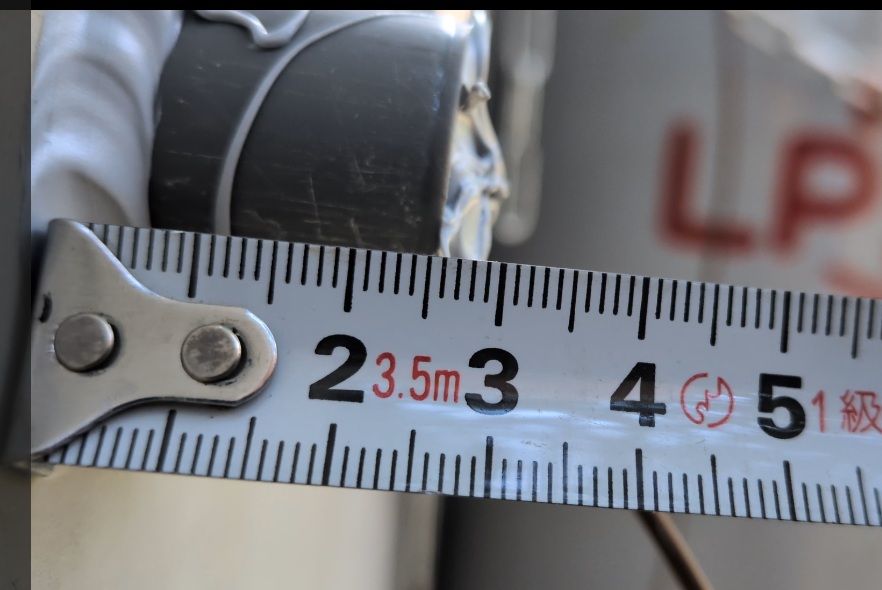

- AE(アコースティック・エミッション)センサー: コンクリート内部でひび割れが発生する際の「音」を捉え、破壊の兆候を察知。

まとめ:コンクリートの「声」を聴く

コンクリートのひび割れや膨らみは、過酷な環境下で耐え続けている構造物からのサインです。 「片面が土、片面が空気」という環境は、私たちが思う以上にコンクリートにストレスを与えています。このメカニズムを理解し、適切な診断とメンテナンスを行うことが、大切な建物の寿命を延ばす唯一の道です。

もし、お住まいや管理物件で気になる兆候を見つけた場合は、単に表面を塗って隠すのではなく、その背後にある「湿度のドラマ」を疑ってみてください。

関連記事

追記:2026年4月更新──ダウングレード不可、YouTube側変更の隣

追記:2026年4月更新──ダウングレード不可、YouTube側変更の隣 まだなし → 2026/4/7には配信されたもよう

まだなし → 2026/4/7には配信されたもよう